OpenAI führt neue Fine-Tuning-Optionen für GPT-4o ein

OpenAI hat die Fine-Tuning-Funktion für das GPT-4o-Modell eingeführt, eine lang erwartete Erweiterung, die Entwicklern die Möglichkeit bietet, ihre KI-Modelle präzise auf spezifische Anwendungsfälle abzustimmen. Diese Funktion ermöglicht es, die Struktur und den Ton von Antworten anzupassen oder komplexe, domänenspezifische Anweisungen zu folgen, was zu einer verbesserten Leistung bei geringeren Kosten führt.

Bildquelle: OpenAI

Mit der neuen Fine-Tuning-Option können Entwickler das GPT-4o-Modell mit benutzerdefinierten Datensätzen trainieren, um genauere und besser angepasste Ergebnisse für ihre spezifischen Anwendungsfälle zu erzielen. Diese Anpassungen können mit minimalen Daten vorgenommen werden, wodurch bereits wenige Dutzend Beispiele im Trainingsdatensatz ausreichen, um signifikante Verbesserungen zu erzielen.

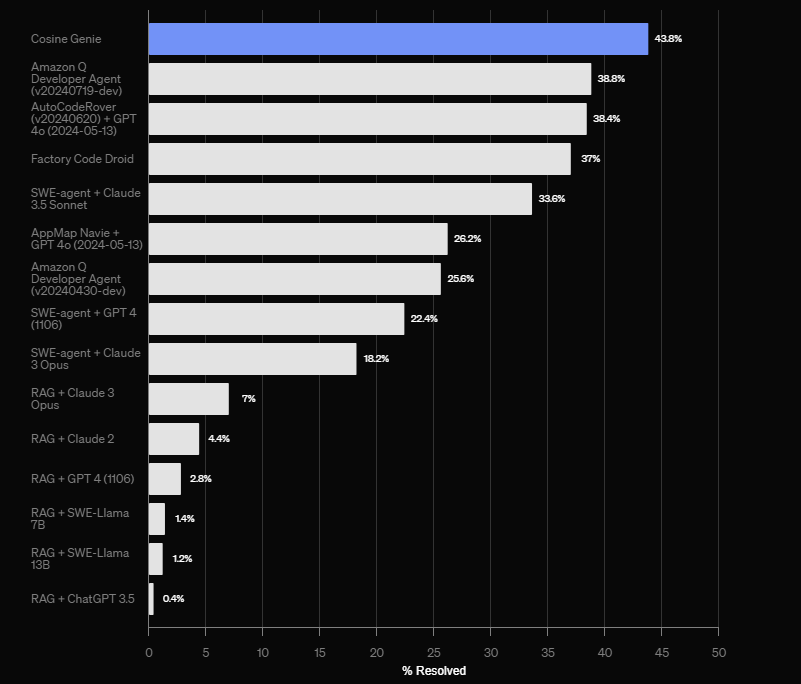

Bereits in der Testphase haben Unternehmen wie Cosine und Distyl Erfolge mit dem Fine-Tuning von GPT-4o erzielt. Cosine hat beispielsweise mit seinem KI-gestützten Softwareentwicklungsassistenten Genie die besten Ergebnisse im SWE-bench Verified Benchmark erzielt, während Distyl auf dem BIRD-SQL Benchmark den ersten Platz belegen konnte. Diese Erfolge unterstreichen das Potenzial des Fine-Tunings für spezialisierte Anwendungen.

Fine-Tuning für GPT-4o ist ab sofort für alle Entwickler auf allen kostenpflichtigen Nutzungsebenen verfügbar. Die Kosten für das Training betragen 25 Dollar pro Million Tokens, während die Inferenzkosten bei 3,75 Dollar pro Million Eingangstokens und 15 Dollar pro Million Ausgangstokens liegen. OpenAI bietet darüber hinaus bis zum 23. September täglich 1 Million kostenlose Trainingstokens an.

Datenschutz und Sicherheit

OpenAI legt großen Wert auf Datenschutz und Sicherheit, insbesondere bei der Nutzung von Fine-Tuning. Alle durch Fine-Tuning erzeugten Modelle bleiben vollständig unter der Kontrolle der Entwickler, und es wird sichergestellt, dass die Geschäftsdaten einschließlich aller Eingaben und Ausgaben nicht weitergegeben oder zur Schulung anderer Modelle verwendet werden. Darüber hinaus implementiert OpenAI laufend Sicherheitsmaßnahmen, um den Missbrauch der Modelle zu verhindern.